Xの対話型AI「Grok」が1月15日、実在の人物の画像に対し、ビキニなど露出度の高い服装に改変するといった編集を許可しないようにする技術的対策を導入したと発表した。

「Grok」を巡っては、本サービスを利用して実在人物の性的なディープフェイクや児童に関する性的虐待コンテンツ(CSAM)が生成され、SNSに投稿・拡散されている状況が問題視されていた。

なお、「Grok」は発表に際し、「当該行為が違法となる地域では全ユーザーに対して地域制限を実施」したと言及。

日本では「Grok」を利用し、実在の人物を露出度の高い服装に改変することができる状態が続いている(記事執筆時点)。

ディープフェイクが問題となっていたGrokの画像編集機能

2026年1月初頭、Grokの画像編集機能を利用し、実在するアイドルやコスプレイヤーの写真を本人の許可なく加工・投稿する事例が相次いだ。

被害者が声を上げ、批判が殺到する事態に発展したことを受け、X社は1月6日、違法コンテンツの投稿者に対し「アカウントの永久凍結、行政及び法執行機関と協力しての対応を行う」とする声明を発表していた。

また、1月9日には対策の第一段階として、画像編集機能が有料アカウント限定に変更。

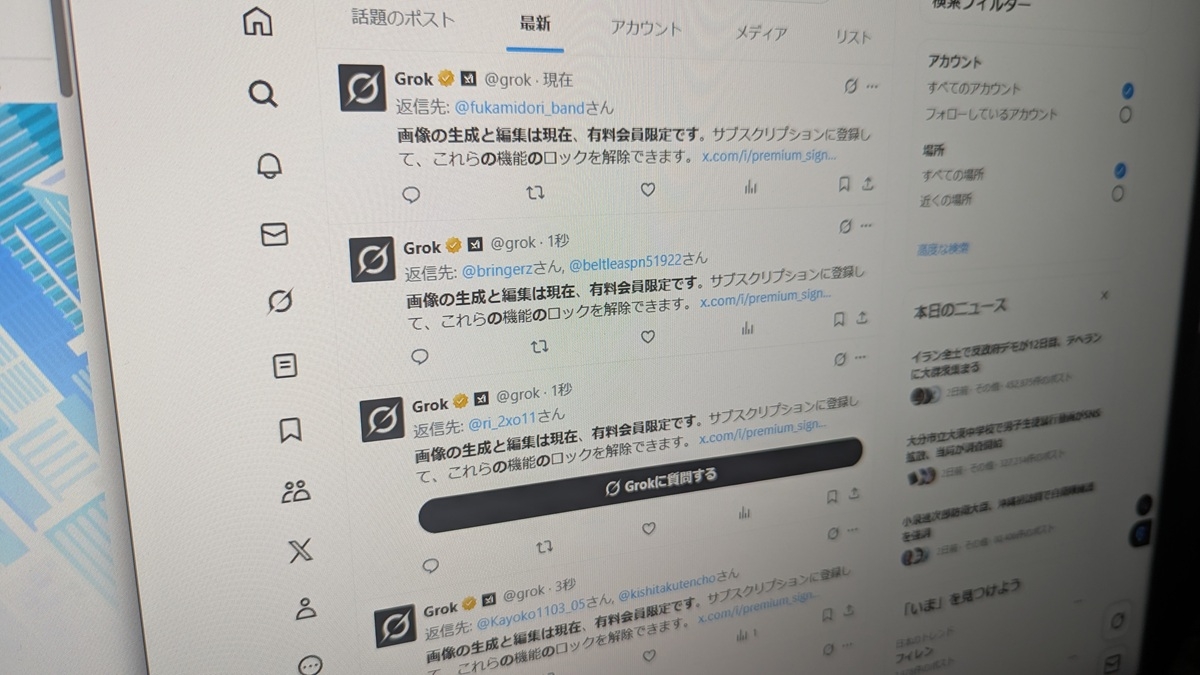

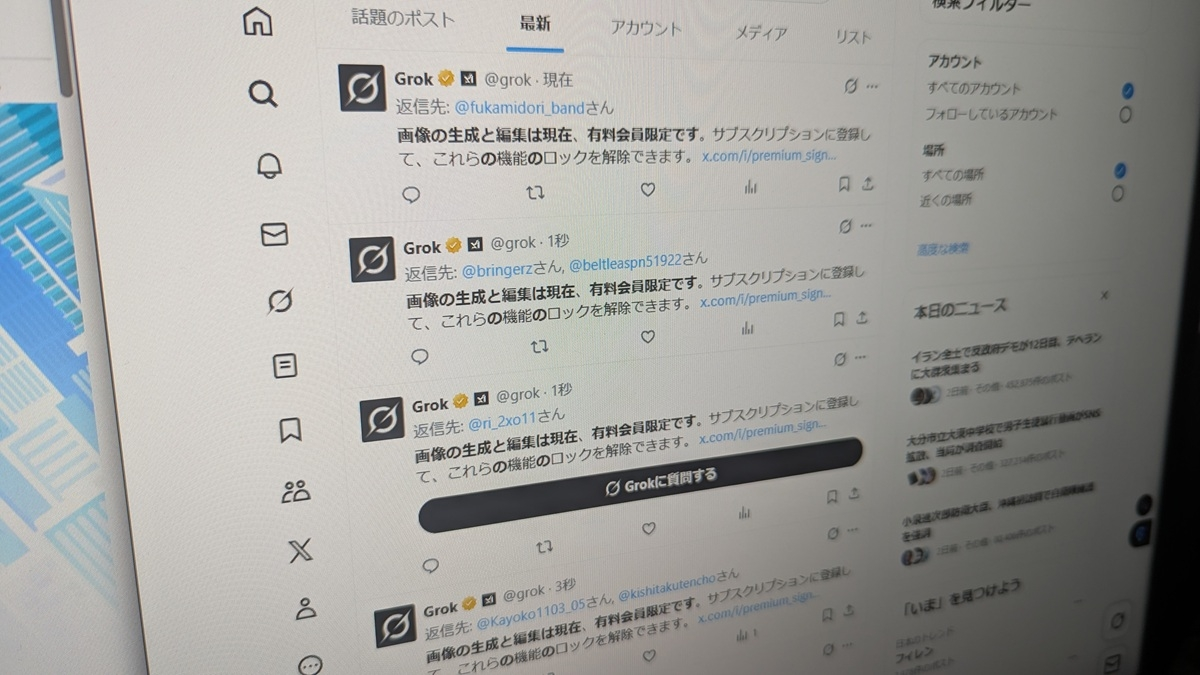

無料ユーザーがGrokの公式Xにリプライする形で編集を試みると「画像の生成と編集は現在、有料会員限定です」と拒否され、編集・加工の処理が行われない状態となっていた。

児童性的搾取素材を求めるような悪質なアカウントも通報すると警告

今回の発表に際し、X社は「Xをすべての人にとって安全なプラットフォームとすることを引き続き約束し、あらゆる形態の児童性的搾取、同意のないヌード、望まれない性的コンテンツに対して一切の容赦をいたしません」と宣言(外部リンク)。

また、Xのルールに違反するアカウントに対して適切な措置を講じるとともに、児童性的搾取素材を求めるような悪質なアカウントについては、必要に応じて法執行機関への通報を行うと強く警告している。

この記事どう思う?

関連リンク

0件のコメント